Решение задачи 9 – 3 ÷ 1/3 + 1 =?

В социальных сетях разгорелись жаркие споры на тему решения казалось бы крайне простой задачи 9 – 3 ÷ 1/3 + 1 и в описании этой задачи говорилось что особую популярность она получила в Японии где ее не могли решить 60% взрослых.

Давайте разберем решение этой задачи и в чем может быть проблема. Начнем пожалуй с популярных ошибок.

- Не правильная очередность операций. Вспоминаем что деление и умножение имеют приоритет перед плюсом и минусом, поэтому сначала надо выполнить среднюю часть, а затем боковые.

- Возникает проблема с выяснением числителя и знаменателя. Числитель либо 1, либо 3:1

Если с первой ошибкой все ясно, то вторую мы разберем подробнее. Средняя часть у нас выглядит так: 3 ÷ 1/3

Поскольку деление и знак дроби одно и тоже действие то можно переписать по другому: 3/1/3. Из математики пятого класа мы знаем что это выражение можно сократить, для этого нижнюю дробь мы просто переворачиваем с противоположным знаком и выходит 3*3/1 что равно 9.

Вторым способом решения этой дроби может быть более простой способ для взрослого человека который забыл что такое дроби. Помним что 1/3 это 0.3333333. Делим на калькуляторе 3 на 0.3333333 и получаем все туже девятку.

Но не забывает что это еще не ответ, а просто решение средней части. Нам осталось решить задачу до конца.

Итак у нас осталось 9-9 +1 что равно 1.

Ну или англоговорящие посетители блога могут посмотреть ролик где решение описывают аж в 4-х минутном видео:

На этом все, но если у вас остались вопросы или пожелания — напишите в комментариях, попробую вам помочь.

Об авторе

Andrey

Администратор блога. Специалист по маркетингу, развитию бизнеса, здоровому образу жизни. Владелец и директор двух компаний в Украине. Сертифицированный специалист Apple. Увлечения: бизнес, спорт, дайвинг.

Комплексные числа · Калькулятор Онлайн

Введите комплексное выражение, которое необходимо вычислить

Выполняет простые операции с комплексными числами.

Также умеет:

- Выполнять деление с подробным решением

- Находить разные формы комплексных чисел:

- Алгебраическую

- Тригонометрическую

- Показательную

- Модуль и аргумент комплексного числа

- Комплексно-сопряжённое к данному

- Геометрическую интерпретацию комплексного числа

Правила ввода комплексных выражений с примерами:

- Комплексное число записывается в виде

- a + bj, например 1.5 + 4.7j (j писать слитно)

- Комплексная единица (Мнимая)

- — должна записываться в виде 1j (Просто j не будет работать)

- (3+4j)/(7-5j)

- — деление

- (3.6+4j)*(7+5j)

- — умножение

- (3+56j)^7

- — возведение в степень

- (5+6j) + 8j

- — сложение

- (5+6j) — (7-1j)

- — вычитание

- conjugate(1+4j) или conj(1+4j)

- Сопряженное (комплексно-сопряженное) число для (1 + 4j)

Можно использовать следующие функции от x (например, x = 1 + 2.5j):

Правила ввода выражений и функций

Выражения могут состоять из функций (обозначения даны в алфавитном порядке):- absolute(x)

- Абсолютное значение x

(модуль x или |x|) - arccos(x)

- Функция — арккосинус от x

- arccosh(x)

- Арккосинус гиперболический от x

- arcsin(x)

- Арксинус от x

- arcsinh(x)

- Арксинус гиперболический от x

- arctg(x)

- Функция — арктангенс от x

- arctgh(x)

- Арктангенс гиперболический от x

- e

- e число, которое примерно равно 2.7

- exp(x)

- Функция — экспонента от x (что и e^x)

- log(x) or ln(x)

- Натуральный логарифм от x

(Чтобы получить log7(x), надо ввести log(x)/log(7) (или, например для log10(x)=log(x)/log(10)) - pi

- Число — «Пи», которое примерно равно 3.14

- sin(x)

- Функция — Синус от x

- cos(x)

- Функция — Косинус от x

- sinh(x)

- Функция — Синус гиперболический от x

- cosh(x)

- Функция — Косинус гиперболический от x

- sqrt(x)

- Функция — квадратный корень из x

- sqr(x) или x^2

- Функция — Квадрат x

- tg(x)

- Функция — Тангенс от x

- tgh(x)

- Функция — Тангенс гиперболический от x

- cbrt(x)

- Функция — кубический корень из x

- Действительные числа

- вводить в виде 7.5, не 7,5

- 2*x

- — умножение

- 3/x

- — деление

- x^3

- — возведение в степень

- x + 7

- — сложение

- x — 6

- — вычитание

Другие функции:

- floor(x)

- Функция — округление x в меньшую сторону (пример floor(4.5)==4.0)

- ceiling(x)

- Функция — округление x в большую сторону (пример ceiling(4.5)==5.0)

- sign(x)

- Функция — Знак x

- erf(x)

- Функция ошибок (или интеграл вероятности)

- laplace(x)

- Функция Лапласа

Видео пример

Делал по нему опросы

И сейчас попробую обосновать мою новую точку зрения, которая теперь выглядит так:

Дело в том, что между алгеброй и арифметикой есть разница в порядке действий:

Теперь понятно, почему инженерный калькулятор показывает ответ: 1.

Он не сломался. Он алгебраический.

Алгебраический калькулятор считает по правилам алгебры.

Осталось понять, алгебраический это пример или арифметический. От этого будет зависеть ответ.

Букв в примере нет, однако, в нем есть пропущенный знак умножения перед скобкой:

Случаи возможного пропуска знака умножения:

- Между буквенными множителями;

- Между числовым и буквенным множителем;

- Между множителем и скобкой;

- Между выражениями в скобках.

И получается, что если выражение (2+1) заменить на икс, то написание 6/2Х читается как «шесть, разделить на два икса».

Тогда ответ: 1.

Но почему тогда самая умная штука на Земле — Гугл-поисковик считает, что ответ 9?

Потому что и Гугл и смартфон считают по арифметическим правилам.

Но вот тут есть тонкий момент. Арифметические правила должны, по-правильному то, действовать при указании знака умножения. Так, как я написал здесь:

Тут уже нет оснований применять правила алгебры, в которых пропущенный знак умножения считается неразрывным. И ответ получается: 9.

Вывод:

Всё зависит от того, алгебра это или арифметика.

Еще интересные штуки:

Задачи, ломающие мозг (с ответами, спрятанными под спойлер)

Тренировка ума развивальщика предприятий

ЗАДАЧА, В КОТОРОЙ ПОСТОЯННО ОШИБАЮТСЯ: Вас приглашают на работу финансовым аналитиком в Газпром

Подписывайся, мыслитель!

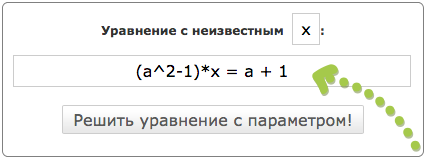

Сайт решает несколько типов уравнений с параметрами:

- линейные с параметром

- квадратные с параметром

Например, если требуется решить линейное уравнение с параметром: (a^2-1)*x = 1 + a

Дано уравнение с параметром: $$x \left(a^{2} — 1\right) = a + 1$$ Коэффициент при x равен $$a^{2} — 1$$ тогда возможные случаи для a : $$a < -1$$ $$a = -1$$ $$a > -1 \wedge a < 1$$ $$a = 1$$ Рассмотри все случаи подробнее:

При $$a < -1$$ уравнение будет $$3 x + 1 = 0$$ его решение $$x = — \frac{1}{3}$$ При $$a = -1$$ уравнение будет $$0 = 0$$ его решение — любое x При $$a > -1 \wedge a < 1$$ уравнение будет $$- x — 1 = 0$$ его решение $$x = -1$$ При $$a = 1$$ уравнение будет $$-2 = 0$$ его решение: нет решений

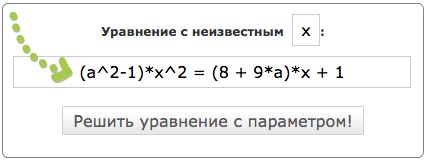

Пример решения квадратного уравнения с параметром

(a^2-1)*x^2 = (8 + 9*a)*x + 1

Дано уравнение с параметром: $$x^{2} \left(a^{2} — 1\right) = x \left(9 a + 8\right) + 1$$ Коэффициент при x равен $$a^{2} — 1$$ тогда возможные случаи для a : $$a < -1$$ $$a = -1$$ $$a > -1 \wedge a < 1$$ $$a = 1$$ Рассмотри все случаи подробнее:

При $$a < -1$$ уравнение будет $$3 x^{2} + 10 x — 1 = 0$$ его решение $$x = — \frac{5}{3} + \frac{2 \sqrt{7}}{3}$$ $$x = — \frac{2 \sqrt{7}}{3} — \frac{5}{3}$$ При $$a = -1$$ уравнение будет $$x — 1 = 0$$ его решение $$x = 1$$ При $$a > -1 \wedge a < 1$$ уравнение будет $$- x^{2} — 8 x — 1 = 0$$ его решение $$x = -4 — \sqrt{15}$$ $$x = -4 + \sqrt{15}$$ При $$a = 1$$ уравнение будет $$- 17 x — 1 = 0$$ его решение $$x = — \frac{1}{17}$$

Leave A Comment